易翻译把“句型转换”当作一步步的问题拆解:先把输入变成可读的“语法和语义地图”,用神经模型和规则把地图映射到目标语言的结构,再用重排、词形变化和语气调整把句子“打磨”成自然、符合场景的输出。整个过程兼顾实时性、上下文和用户偏好,既有统计/规则的确定性,也有神经网络的灵活性。

先说清楚:什么是“句型转换”

简单来说,句型转换就是把一句话的结构从一种语言的表达方式,变成另一种语言自然可读的等效表达。这不仅仅是单词替换,而包括语序、主谓宾关系、时间状语、从句嵌套、被动/主动、语气和礼貌程度等多方面的调整。

用一个比喻来理解(费曼法)

想象你拿着一张房屋蓝图(原句的语法结构),要把它改造成另一种风格的房子(目标语的句型)。你不能只换瓷砖(词汇),得拆掉一些墙(重排)、改变门窗位置(语序),还得用当地的建筑规范(语法规则)和审美(语气、正式程度)来修整。易翻译就是既有经验丰富的工匠(规则和词典),又有善于学习的机器人设计师(神经网络),两者合作把蓝图变成新房子。

易翻译转换句型的总体流程(分步讲清楚)

- 输入感知:文本、语音或图片(OCR)先被识别成原始字符流和时间戳。

- 预处理:分词/子词切分、词性标注(POS)、命名实体识别(NER)、句法分析(依存或成分句法)、拼写/断句纠错。

- 语义表示:编码器把词序和句法信息编码成向量表示,形成“句子的语义地图”。

- 句型迁移与重排:结合注意力机制(attention)和隐含的对齐关系,进行结构转换;必要时加入规则/模板处理特定现象。

- 解码与生成:解码器在目标语言的词汇表和语法约束下,按一定搜索策略(beam search等)生成句子。

- 后处理:标点恢复、大小写调整、数字/单位格式、本地化、礼貌用语及人工规则修正。

- 质量估计与反馈:通过置信度评分、用户纠正和在线学习不断优化模型。

逐步展开每步在“句型转换”中起的具体作用

预处理是基础。没有正确的分词和句法结构,后面就像地图有错。举个例子:

| 源句(英语) | I gave him a book yesterday. |

| 中文直译(词序) | 我 给 他 一本 书 昨天。 |

| 自然中文(句型转换后) | 我昨天给了他一本书。 |

在预处理阶段,系统会识别出时间状语“yesterday”、动词“gave”及其宾语等,标出时态。这样在后续步骤里,系统就知道中文中时间状语通常前置,需要把“yesterday”提前。

语义表示用的是神经网络的“向量化”。这一步把句子中各词和它们的关系编码成一堆数字,模型可以在这些数字空间里“看见”哪些词是主语宾语、哪些是修饰语、句子整体是陈述还是疑问。

迁移与重排是真正的“句型转换核心”。传统方法有规则和短语表,而现代系统主要靠Transformer类的模型学会重排:注意力机制会自动对齐源词和目标词,隐含地实现语序变化。但对于有特殊习惯的结构(比如日语的敬语、中文的把字句),通常会结合人工规则或专门的子模块来保证准确。

举更具体的例子:被动句与主题句的转换

被动语态的处理是个常见挑战。英语习惯被动(The cake was eaten by Tom),中文更自然的往往是主动或者主题句(蛋糕被汤姆吃了 / 汤姆吃了蛋糕)。易翻译如何选择取舍?

- 先识别被动结构(被动助词、动词形式、介词短语by/由等)。

- 结合上下文和风格偏好:若用户偏好正式或保留被动信息,会选择保持“被”字句;若倾向口语化,系统可能改为主动。

- 进行语序重排并调整词形(例如时态、完成体)。

示例:

| 源句 | The results were announced by the committee yesterday. |

| 直译(保守) | 结果昨天被委员会宣布了。 |

| 自然中文(主动/口语) | 委员会昨天宣布了结果。 |

长句、从句与信息结构的处理

长句往往包含多个子句,句型转换需要保持逻辑关系。易翻译常用的策略:

- 句子拆分:把过长或并列/从属关系清晰的句子拆成多句逐条翻译,再合并;

- 从句标注:对定语从句、状语从句、宾语从句进行类型识别,决定在目标语中的插入位置;

- 指代与共指解析:解决代词和名词短语的指向,避免译文歧义。

例如一句英文长句:

“When the committee, which had met several times, finally reached a consensus, they decided to postpone the release until the data were verified.”

系统会先识别出插入的定语从句“which had met several times”、主句时间状语“when… finally reached a consensus”,在中文里合理重排为:“委员会在多次开会后最终达成共识,决定将发布推迟,直到数据核实为止。”

规则与神经网络如何协同工作

纯神经模型很灵活,但在一些边界场景(数字、专有名词、格式、法律文本、模板句)上需要规则保证准确性。易翻译通常采用混合策略:

- 先通过模型生成候选译文;

- 再用规则和术语表做约束与替换;

- 对特定模式(如时间、货币、表格)直接用模板处理以避免歧义。

一个小例子:数字和单位

| 源句 | The device weighs 0.5 kg and costs $1,299. |

| 候选译文 | 该设备重0.5千克,价格为$1,299。 |

| 后处理(本地化) | 该设备重0.5 千克,售价为 1,299 美元。 |

这里规则保证单位和货币格式符合中文阅读习惯,并可能按地区偏好把美元符号展开成“美元”。

语音翻译与拍照(OCR)输入下的句型转换要点

语音和图片带来额外噪声:识别错误、漏词、断句不清。易翻译做了两方面优化:

- 鲁棒预处理:ASR后的假设空间(n-best)会传给翻译模块,模型能够在多个备选中选出最合理的语序;

- 断句与标点恢复:语音常常没有明确标点,系统会用模型预测句首句尾,决定句型迁移的边界;

- OCR的上下文校正:拍照识别出的词若有低置信度,会结合语言模型和前后文进行修正,避免错误重排。

双语对话模式:保持自然的句型衔接

对话翻译强调连贯与短时记忆。句型转换不仅要单句正确,还要保留上文信息:

- 维护短期对话历史,解决代词、指代和省略句;

- 根据说话人身份和语境调整语气(礼貌/亲切);

- 在实时场景中优先低延迟策略:先给出可理解的翻译,再在后台做更精细的句型润色。

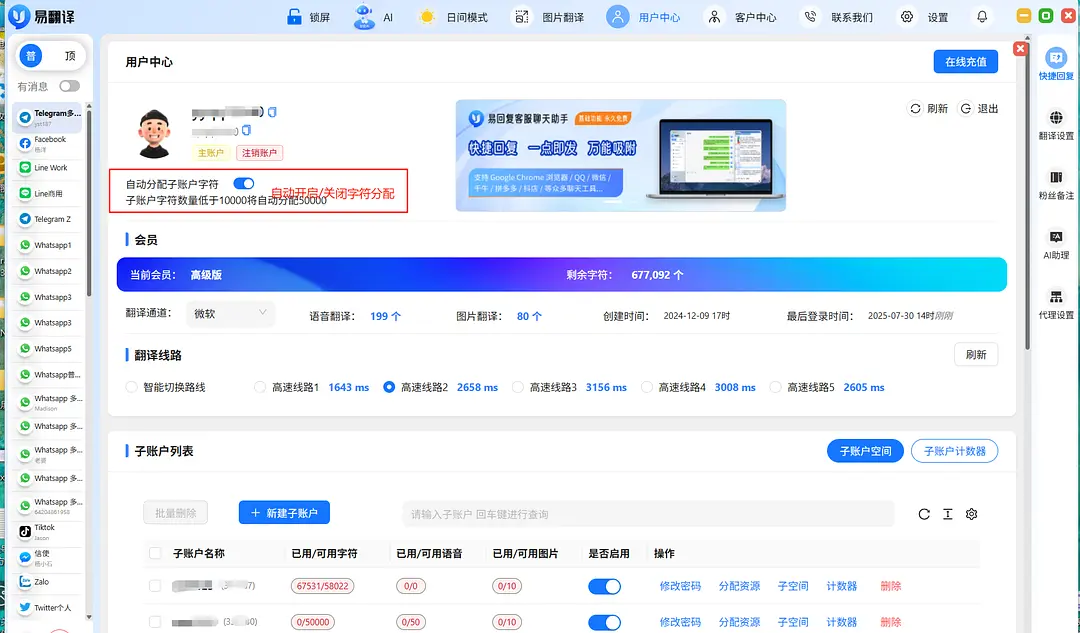

质量控制、用户可控选项与持续学习

要把句型转换做得既正确又自然,系统会引入多种质量控制手段:

- 领域自适应:根据行业语料微调模型,避免商务/医学/法律领域出错;

- 术语和风格表:企业或用户能上传术语表和风格偏好,系统在生成时优先遵循;

- 置信度与人工回放:低置信度的片段会被标注,供人工审核或提示用户;

- 在线学习:用户的纠正会作为反馈(在得到许可后)用于模型更新,提高句型处理能力。

系统在选择“保守翻译”或“自然重写”之间如何权衡?

这是个设计决策,通常依据:用途(法律 vs 日常)、用户设置(忠实 vs 自然)、置信度(高置信度可更自由改写)。例如在合同翻译中优先忠实保留句型,而旅游对话更倾向于口语化。

一些常见句型转换案例(对照说明)

| 源句 | 转换要点 | 目标句(示例) |

| He insisted that she be present. | 虚拟语气识别,中文常用“坚持要/要求” + 从句(不保留虚拟形式) | 他坚持要她在场。 |

| Not only did she sing, but she also danced. | 倒装句识别,转换为并列句 | 她不仅会唱歌,而且还会跳舞。 |

| I haven’t seen him since last year. | 完成时态与时间状语处理 | 自从去年以来我就没见过他。 |

几点实际工程落地的细节(写给产品和工程同学)

- 模型部署要兼顾延迟与准确率,移动端多用轻量化模型+云端回退;

- 要有明确的错误恢复机制:识别失败时把原文回显给用户并提供多种翻译候选;

- 隐私和数据安全要到位,用户反馈的数据若用于训练必须匿名化并征得同意;

- 日志和可解释性:当句型被“奇怪”地重写时,需要可追溯的对齐信息帮助调试。

常见误区(顺带说明)

- 误以为“多训练数据=万能”。数据重要,但规则和后处理在特定句型(如法律、术语)上不可或缺。

- 误以为神经网络会理解“常识”。模型常犯常识错误,需要外部知识库或规则校验。

写到这里,我心里还想着几个真实场景:旅游时的“我想要退房”该译成“I want to check out”还是“I’d like to check out now”取决于礼貌程度和上下文;商务邮件里一句被动语态可能是故意的模糊,直接改成主动就可能改变语气。易翻译在设计句型转换时正是把这些细节都考虑进来了,所以你看到的结果既不是冰冷的直译,也不是胡乱的潤色,而是有据可依的平衡。