易翻译在译串词时,先用语音识别分段、标点恢复和说话人区分,再结合上下文窗口与神经机器翻译模型进行短语对齐与重排列,最后通过后处理规则、术语库和用户记忆校正译文风格与流畅度。

先把问题说清楚(用费曼法第一步)

简单来说,所谓“串词”通常是指说话时词语连接、断句不清或临时插入片段,导致一句话在语义和结构上看起来被“串”在一起。易翻译的做法并不是靠一个神奇的按钮去“拆”句子,而是把这件事拆成许多小任务:把声音变成文字、把文字切成可翻译的块、理解上下文关系、把译文拼成自然表达,然后再修整风格和专有名词。(嗯,就像做菜——先切菜、再调味、最后摆盘。)

核心流程一览(先看全景)

- 音频采集与预处理:噪声抑制、回声消除、语音活动检测(VAD)等。

- 自动语音识别(ASR):把语音转换为文字,同时输出置信度、时间戳和说话人标识。

- 分段与标点恢复:将连续文字切成有意义的句段,并补入标点、恢复被省略的停顿。

- 上下文建模:保留前后句信息,建立短时上下文窗口,防止孤立翻译导致错位。

- 神经机器翻译(NMT):基于Transformer等模型进行翻译,同时做短语对齐与重排序。

- 后处理与术语一致性:术语库、用户词典、风格规则、流畅性调整与置信度提示。

把每个环节拆开来讲(深入但不绕弯)

1. 音频处理:把嘈杂变干净

先想到的是麦克风、环境噪声、回声这类物理问题。易翻译在这一层做的事情包括:

- 实时噪声抑制和回声消除,保证ASR拿到相对干净的波形;

- 语音活动检测(VAD)来识别说话段落,避免把环境声误识为语句;

- 多麦克风波束形成(在有硬件支持时),提高说话人的信噪比。

这些步骤看起来“普通”,但对后续识别的准确性影响极大——识别错了,翻译也就没戏。

2. ASR:把串在一起的声音变成文字

ASR不是单纯吐字,它会同时给出时间戳和置信度。关于“串词”,ASR会:

- 处理连读与吞音,通过声学模型(如端到端模型、CTC或注意力机制)尝试恢复实际词序;

- 利用语言模型减少不合语法的输出(比如把“我要去吃饭了啊”识别成“我要去吃饭了”);

- 标注不确定片段(低置信度),供后续模块重点校对或请求用户确认。

3. 分段与标点恢复:把一串话割成句子

真人说话往往没有明确标点,尤其串词时更混乱。易翻译会用专门的模型恢复标点和断句:

- 断句模型基于语调、停顿、连词等信号决定切分点;

- 标点恢复把逗号、句号、问号放回去,这能显著改善翻译质量;

- 同时可能做说话人区分(diarization),在多人对话里防止句子被串到别人话里。

4. 上下文窗口:别只看当前一句

串词的问题很多来自上下文缺乏。比如“他把苹果给了她,结果掉了”——“掉了”指的是谁?易翻译会保留上文若干句作为上下文窗口,让NMT有更多信息判断代词和省略项。

5. NMT与短语对齐:把意思转成另一种语言

主力是神经网络翻译器(常见是Transformer变体)。关键点包括:

- 子词分割(BPE、SentencePiece)处理不规则拼接词;

- 注意力机制帮助对齐源语与目标语短语,解决语序差异;

- 对于串词产生的奇怪组合,模型会依靠上下文和训练样本猜测最可能的重组方式;

- 如果置信度低,系统会触发备选译文或显示不确定提示。

6. 后处理:修饰、术语和风格

翻译出来的初稿通常需要“润色”,这一步包括:

- 术语库和用户词典替换(保证专有名词一致);

- 流畅性修整,例如合并拆分句子、调整代词指向;

- 标点、大小写、数字格式的本地化处理;

- 若为实时对话模式,还会考虑简短、易懂的表达优先。

表格:各模块与职责一目了然

| 模块 | 主要职责 |

| 音频预处理 | 降噪、VAD、回声消除、波束形成 |

| ASR | 语音转文字、时间戳、置信度、说话人标识 |

| 分段/标点恢复 | 恢复句子边界和标点,减少语义歧义 |

| 上下文管理 | 保留历史句子,解决代词和省略问题 |

| NMT | 语义转换、短语重排、翻译置信度 |

| 后处理 | 术语一致性、风格修正、格式化 |

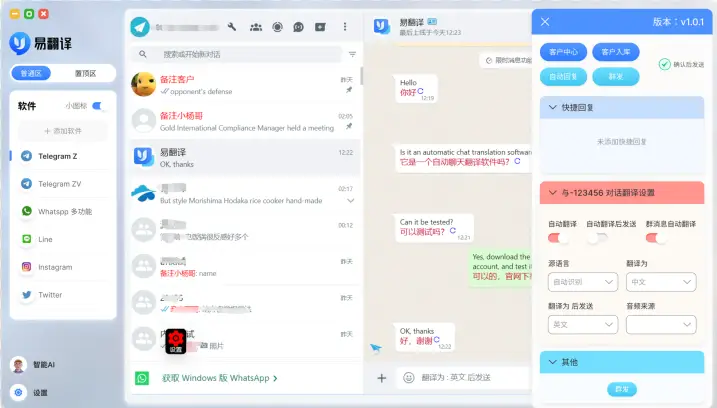

用户能做什么来帮助系统更好地译串词?

有些时候,系统已经尽力了,但你能给它的小帮助会显著提升结果:

- 尽量在安静环境说话,或靠近麦克风;

- 在多人对话中尽量轮流说,避免多人同时插话;

- 如果出现低置信区段,手动确认或在文本框里补充上下文;

- 利用术语自定义功能加入特殊名词、行业用语,系统会逐渐记住你的偏好。

常见限制与处理策略(别怀疑,系统也会犯错)

- 方言与口音:ASR对罕见口音或方言的识别率会下降,对此可通过模型定制或用户词典缓解。

- 重叠讲话:多人同时说话会导致ASR串词严重,这时需要更强的说话人分离或人工干预。

- 极端简语或俚语:如果训练数据里没见过,NMT可能误译,这时应在界面提示并提供替代译法。

- 实时性与准确性取舍:低延迟模式会牺牲一部分上下文依赖,适合对话场景但在复杂串词下效果受限。

举个例子,说得更直观些(模拟场景)

场景:两个人在嘈杂的咖啡厅里讨论,“我昨天和李明去……那个新开的店,东西挺好吃的,就是服务——唉,我忘了叫什么了,反正你下次去看就知道。” 这样的串词里,易翻译的处理会是:先在音频层尽量去噪;ASR输出一串带停顿标注的文字并标注低置信片段;分段模型在“就是服务——唉”插入合适的停顿与标点;上下文窗口保留“新开的店”和“东西挺好吃的”的信息;NMT在翻译时倾向于把“唉,我忘了叫什么了”处理为“I can’t recall the name”而不是把“唉”字直译;最后术语和风格调整让目标语听起来自然。大致就是这样,你看,环环相扣。

技术演进与未来方向(顺手聊两句)

近几年端到端模型、半监督学习、多模态融合(把视觉、上下文时间线也加进来)让串词处理越来越好。未来会更多结合个人化模型(在本地学你的说话习惯)、更长的上下文记忆,以及更精细的置信度反馈(比如“我不确定这部分,你要不要查看原文?”)。

其实,说到这里,我自己也感觉像是在把做菜的每步详细拆开给你看——可能有点啰嗦,但也更容易理解。要是你还有具体的使用场景或一段典型的串词样本,贴出来我可以更具体地讲系统会怎么处理(还有哪些失误点需要人工干预)。