要把“易翻译”监控好,先把要监控的对象拆成几类:可用性、性能、翻译质量、隐私与合规、用户行为,再针对每类建立指标、日志、告警和看板;没有内置管理后台时,用应用端日志、网络层抓包与外部APM结合;团队规模小则先做合规与基本可用性告警,逐步加质量评估与用户反馈闭环。下面分步骤、举例、给工具清单,带你从零到落地一步步搭建可用又合规的监控体系。

为什么要监控“易翻译”?先把问题讲清楚

想象一下,你在机场用它实时翻译对话,翻译卡住或把“起飞”误识别成“起火”,结果就麻烦了。监控的目的,就是把这种风险提前发现、定位并修复。监控不是单纯看服务器是否在线,而是把用户实际体验拆开来测量:能不能连上、多久出结果、译文准确度、安全性如何、用户是否满意。

用费曼方法把复杂事物分解

- 先说明它是什么:监控是对应用运行状态与输出结果的持续观测和告警。

- 再把它拆解:把整体体验分成“可用性、性能、质量、隐私、成本、业务指标”几块。

- 最后举例说明:比如“实时语音互译”,要同时监控语音识别(ASR)成功率、翻译延迟和翻译错词率。

监控对象分类(把要监控的东西列清楚)

对系统做监控之前,先列出要盯的“对象”。下面是常见且必须的几类:

- 可用性:服务是否在线、接口是否能连通。

- 性能/延迟:端到端响应时间、APIs 时延、音视频同步延迟。

- 错误率/稳定性:接口返回错误、崩溃率、重试次数。

- 翻译质量:自动指标(BLEU/ChrF/TER)+ 人工抽样评估 + 用户反馈。

- 资源和成本:CPU、内存、带宽、云费用。

- 安全与合规:是否有敏感信息暴露、日志隐私管理、访问审计。

- 用户体验与行为:转化率、会话长度、常见失败场景。

从用户角度怎么监控(非开发者也能做的事)

普通用户或企业管理员想“监控易翻译”,通常有两条路径:使用应用内或服务端提供的管理/审计功能,或者借助外部工具做被动监测。

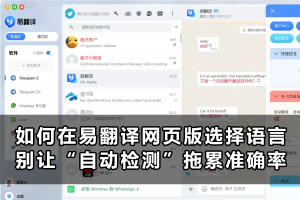

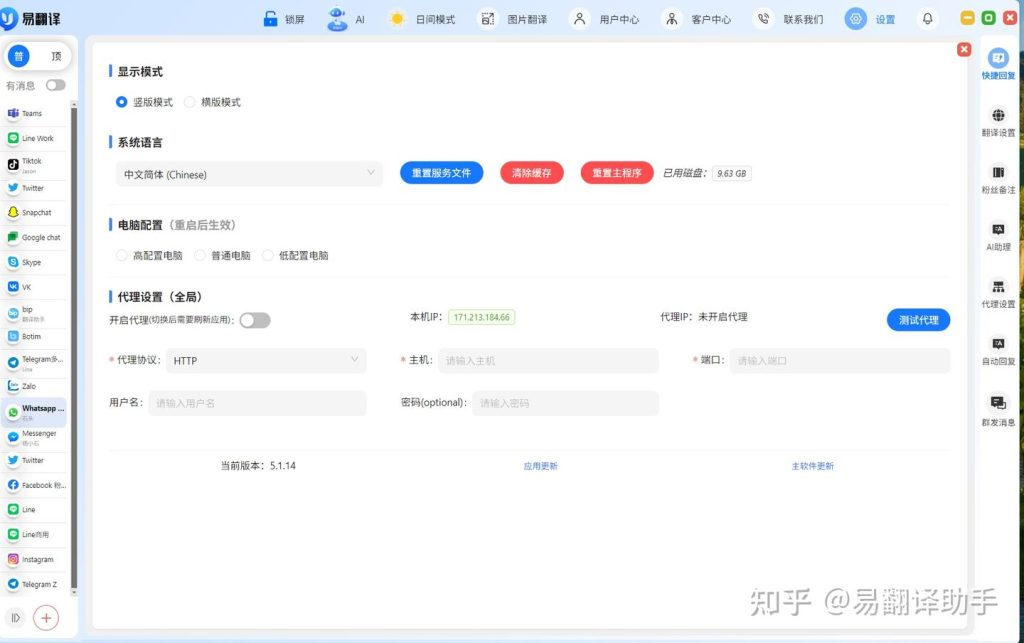

如果产品有管理后台或企业版

- 打开管理控制台(若有),查看“审计日志”、“使用统计”和“导出功能”。

- 设置告警:如每日翻译请求异常增长、接口错误率上升或账单异常。

- 开启访问控制:分配角色权限,开启登录与操作审计。

如果没有管理后台怎么办

- 在客户端保留本地日志(注意去标识化):记录请求时间、请求大小、错误码和延迟。

- 借助设备或网络层工具查看:例如在局域网内用网络流量监测(仅限合规场景),记录请求失败或超时的 IP/端点。

- 建立用户反馈路径:在关键界面放“翻译有问题”触发按钮,收集例句和声纹样本用于回溯。

从开发/运维角度落地监控(详细步骤)

开发与运维需要搭建完整的观测链路:指标(Metrics)、日志(Logs)、追踪(Traces)三支柱(被称为三板斧)。按下面步骤来做:

步骤一:定义目标与SLO/SLA

- 明确业务最重要的体验,如“实时对话端到端延迟≤500ms 的比例≥99%”。

- 设SLO(服务等级目标)并把它映射到告警规则。

步骤二:埋点与指标设计

把要监控的动作写成具体指标:

| 指标 | 含义 | 如何采集 |

| 请求数(qps) | 每秒/每日请求量 | 服务器或API网关统计 |

| 成功率 | 返回200的比例 | 网关/应用日志 |

| p95延迟 | 95分位响应时间 | 应用指标库(Prometheus等) |

| ASR错误率 / WER | 语音识别错误率 | ASR模块输出与人工对比采样 |

| 译文误差率 | 机器译文与人工参考差距 | 自动指标 + 抽样人工评审 |

步骤三:日志与追踪

- 结构化日志:JSON 格式,把 requestId、userId(匿名化)、endpoint、cost、error 写入。

- 分布式追踪:为每次会话打 traceId,跟踪从客户端到翻译引擎再到第三方服务的调用链。

- 错误汇总:用 Sentry、Bugsnag 等收集崩溃与异常堆栈。

步骤四:聚合与展示(看板与告警)

- 用 Grafana/Datadog 展示实时看板,至少包含 QPS、p95/p99、错误率、成本。

- 配置告警渠道:短信、邮件、钉钉/Slack 接口,明确每类告警的负责人与处理时限。

步骤五:演练与回溯

- 定期进行故障演练(game day),验证告警链路与运维流程是否有效。

- 发生故障后做事后分析(RCA),把结论写入知识库,补上监控盲点。

关键监控指标与建议阈值(参考值)

| 指标 | 含义 | 建议阈值 |

| 可用性 | 服务可访问性 | 99.9%-99.99%(根据SLA) |

| p95延迟 | 用户感知延迟 | 实时翻译 < 500ms;文本批量翻译 < 2s |

| 错误率 | 接口异常比例 | ≥1%触发二级告警;≥5%触发紧急告警 |

| ASR WER | 语音识别错误率 | 取决语言与模型,常见目标 <15%-25% |

| 译文满意度 | 用户评级/人工评审合格率 | ≥85%为基本目标 |

翻译质量监控:自动化与人工结合

机器翻译质量是最难自动化的部分。简单的做法是:先用自动指标做退化检测,再用人工抽样做准确定性。

- 自动化检测:每日计算 BLEU/ChrF/TER 指标用于回归检测;对比历史基线,发现明显掉速时触发告警。

- 人工抽样:每天随机抽取若干条用户请求,人工打分(流畅度/忠实度/是否有误导)。

- 用户反馈闭环:在客户端提供“这句翻译是否有用”的快速反馈,优先采集低分样本做回溯。

- A/B测试:新模型上线先小流量灰度,监控两组质量与业务指标后决定是否全量。

实时语音与拍照取词的特殊指标

语音和图像引入了新的故障模式,要关注额外指标:

- 语音抖动与丢包率:网络导致的重传会显著影响延迟与识别质量。

- VAD(语音活动检测)误触发率:会产生空请求或截断。

- OCR识别准确率:光照、字体、角度影响识别结果的可靠性。

- 端到端延迟:采集→传输→识别→翻译→合成(若有)每一段都要量化。

隐私、合规与数据治理(不可忽视)

监控往往意味着更多的日志与数据,这会带来隐私风险。合规是必须做好的第一步:

- 最小化数据:日志只保留必要字段,敏感内容做哈希或脱敏后存储。

- 明确留存期:定义日志与对话数据的保留周期并自动清理。

- 加密传输与存储:传输使用 TLS,静态存储加密并限制访问权限。

- 审计与访问控制:谁能看日志、谁能导出语料,都要有审计记录。

- 合规参考:注意《个人信息保护法》(PIPL)、GDPR 等地域性法规。

工具与技术栈建议(从小团队到企业)

按团队成熟度,可以选择不同工具组合:

- 轻量级(小团队):Prometheus + Grafana + Loki(日志)+ Sentry(异常)

- 中型团队:ELK(Elasticsearch/Logstash/Kibana)或 OpenSearch + Jaeger(追踪)

- 企业级:Datadog / New Relic / Splunk 等一体化 SaaS,带有更强的告警和报表能力

分阶段落地计划(示例:0-3个月、3-6个月、6-12个月)

- 0-3个月:确定SLO,部署基础监控(可用性、错误率、延迟),建立告警;搭建反馈渠道。

- 3-6个月:加入翻译质量自动检测与抽样人工评审,做灰度部署流程与追踪链路。

- 6-12个月:完善用户行为看板、成本分析、合规审计,做灾难演练与自动化恢复脚本。

常见坑与注意事项(实践经验)

- 不要盲目收集所有日志:成本高、隐私风险大,要先想好分析目的。

- 告警噪声会让人“习惯化”而忽略真正的问题——把阈值设置合理,并定期复核。

- 监控指标要贴近用户体验,工程师容易只监控资源指标,忽略了最终感受。

- 翻译质量的波动经常和上游模型或语料变动有关,版本管理要到位。

举个真实可操作的小例子(快速实现)

场景:你是中小团队,需要在两周内能及时发现“实时翻译卡顿”问题。

- 在客户端埋点:每次请求记录 requestId、startTime、endTime、errorCode、网络类型。

- 把日志通过轻量上报(Kafka/HTTP)汇总到临时 ELK 或 Loki 集群。

- 建一个 Grafana 看板,显示 p50/p95 延迟、失败率、QPS,并设置当 p95 > 800ms 或失败率 > 2% 时发钉钉告警。

- 同时在客户端加“问题反馈”按钮,低分反馈会自动附带最近一次请求的 requestId,方便回溯。

结尾的想法(边写边琢磨的那种)

监控不是一次性的工程,而是把“观测能力”当成产品的一部分来打磨。起步时别追求完美,先保证能在用户抱怨或故障时快速定位;然后把质量检测和合规当成长期工作不断完善。监控搭好了,维护成本会下降,用户体验反而会稳步变好。愿你动手时把重要的那几条先做好,剩下的慢慢加。