易翻译的技术联接基于客户端—云端混合架构:客户端集成ASR、TTS、OCR等本地模块,通过HTTPS、WebSocket或gRPC与云端NMT、并行词库、会话路由和负载均衡服务交互。鉴权、加密、缓存与同步机制保障实时翻译、拍照取词和双语对话的稳定性与安全性,并支持SDK和REST API对接第三方应用便捷化。

先说个直观的比喻

想象一下你和朋友通过手机聊天,手机负责“听”和“拍照”,云端负责“理解”和“翻译”,二者通过一条稳稳的“管道”互通信息。要想翻译既快又准确,这条管道要快(低延迟)、要稳(可靠连接)、还要聪明(支持上下文、词库和模型更新)。下面我一步步把这条管道拆开讲清楚,像教别人一样,越简单越好。

总体架构:客户端 + 云端的分工

先把系统拆成两大块:

- 客户端(手机/桌面/嵌入式):负责采集数据(语音、文字、图片)、做预处理(去噪、切分、排版识别),以及在有条件时做本地推理以降低延时和保护隐私。

- 云端(后端服务与模型集群):负责大模型推理、并行词库查询、会话管理、日志与监控、模型更新和训练流水线。

客户端具体做什么

客户端不是只负责“录音/拍照”,它承担了不少确保体验流畅的工作:

- 语音采集与实时ASR(自动语音识别):分帧、噪声抑制、VAD(语音活动检测),把声音切成识别友好的小块。

- 边录边流:通过WebSocket或gRPC把流式音频发送到云端,得到流式识别结果,避免等待整段上传再识别。

- 局部推理:在网络不好或对隐私敏感时,本地运行轻量化ASR/TTS或离线翻译模型(量化/剪枝过),结果在本地展示并与云端结果同步。

- OCR拍照取词:预处理图片(去畸变、增强),做文本检测(EAST/CRAFT类方法)、文字识别(CRNN/Transformer OCR),并把识别到的文本发送到翻译引擎。

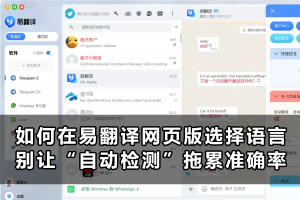

- 会话和UI管理:保留上下文、回滚上一次翻译、管理用户词库和纠错反馈。

云端具体做什么

云端是“大脑”和“仓库”,承担重计算与长期记忆:

- 翻译引擎(NMT):神经网络模型负责从源语言到目标语言的转换,支持批量和流式两种推理模式。

- 词库与翻译记忆(TM):存放行业术语、用户自定义词条与历史句对,做优先替换或短语融合,提升一致性。

- 会话路由与状态管理:把同一用户或同一对话的上下文串联起来,避免每句都孤立翻译。

- 模型服务与调度:GPU/TPU集群、模型分片、在线蒸馏与自动伸缩(Kubernetes + 节点池),保证并发与低延迟。

- 缓存与加速:用Redis等缓存常见翻译结果、词条和预生成片段,减少重复计算。

连接细节:协议、鉴权与数据流

现在我们把“管道”细化成几条具体技术路线,帮助你知道哪部分在哪种场景下用什么技术。

常用协议

- HTTPS / REST:适合短文本或批量请求(拍照上传后一次性翻译)。使用简单,兼容性好。

- WebSocket:适合实时双向流(边说边翻),保持长连接,延迟低。

- gRPC:适用于高并发、低延迟场景,支持双向流与二进制压缩,服务间调用常用。

鉴权与安全

连接必须安全可信,常用做法包括:

- 传输层加密:TLS(HTTPS)/mTLS(互相验证)。

- 应用层鉴权:JWT或OAuth2,短期有效的访问令牌与刷新机制,日志中不存敏感明文。

- 隐私保护:敏感语音/图像可选择本地解析或脱敏后上传,合规保留最少必要数据。

实时互译怎么做到低延时又准确

这往往是产品的核心体验:觉得它“很快”或“卡顿”。实现上有几招并用:

- 流式ASR + 流式翻译:一边识别一边发送中间结果,云端做增量翻译并逐步回填最终句子。

- 本地短句优先:对短常见语句先用本地小模型快速返回,云端结果回来再做纠正。

- 模型压缩与加速:量化、蒸馏、ONNX/TensorRT加速,实现同等语义下更快推理。

- 缓存与预测:对于固定问候、菜单项、常用短语提前缓存;使用语言模型预测下一词并预计算。

拍照取词的技术链路

从拍照到得到译文,流程可以分为几个阶段:

- 图像预处理:去噪、透视校正、分辨率调整。

- 版面分析:识别文本块与图像区域,确定语言、方向与字体特征。

- 文本检测与识别:检测文本框(EAST/CRAFT),OCR识别(CRNN/Transformer OCR)。

- 后处理与规范化:处理数字、单位、专有名词并调用词库。

- 翻译与显示:将识别结果传到翻译引擎并同步显示在原图上或文本列表中。

双语对话中的上下文管理

让机器懂上下文听起来简单,但工程上需要注意:

- 会话ID与发言顺序:把同一对话绑定在一个会话上下文,避免把不同人的话混在一起。

- 核心实体保持一致:人名、地点、术语在会话里应保持一致的翻译表现。

- 回溯与纠错:允许用户纠正翻译并把纠正结果写入个人词库,影响后续翻译。

接口示例(一眼看懂哪个接口用在哪)

| 接口类型 | 何时用 | 优点 |

| REST(HTTPS) | 拍照取词、批量文本翻译 | 易用、兼容性好 |

| WebSocket | 流式语音识别与实时翻译 | 低延迟、双向通信 |

| gRPC | 高并发后台服务调用 | 性能好、二进制高效 |

工程层面的关键组件

- 模型服务:Triton / TensorFlow Serving / 自研推理服务;支持批处理与流式推理。

- 调度与伸缩:Kubernetes + HPA/Cluster Autoscaler 管理GPU节点,保证峰值时段也能应付。

- 缓存层:Redis缓存热词、热门句对、用户词库。

- 消息队列:Kafka/RabbitMQ用于异步日志、训练数据汇聚和任务调度。

- 监控与告警:Prometheus/Grafana监控延迟、错误率,确保体验可观测。

对接第三方/开发者注意事项(实用清单)

- 选择对接方式:有实时需求就用WebSocket/gRPC,非实时就用REST。

- 做好重连与降级逻辑:网络差时退回本地模型或显示“正在重连”的友好提示。

- 管理鉴权与配额:合理使用短期Token并处理超额限流,记录失败原因便于复现。

- 收集最小日志:调试用足够但不泄露敏感信息,用户隐私优先。

常见问题与应对策略

- 延迟高:检查网络、是否走了云推理、是否启用了模型批处理导致等待。

- 识别错误多:改进ASR采样率和噪声抑制,增加领域词库。

- 术语不一致:开放用户词典,支持术语优先匹配。

更多可参考的学术/工程资料

可读的资料有:“Neural Machine Translation and Sequence-to-Sequence Models”、“Practical OCR: From Images to Text”、以及工业实践文章如“实时语音翻译系统设计”。这些可以帮助把上面的原理和实现细节连成一个完整的工程视图。

好了,说着说着有点像把思路往外倒——但大体上就是这么一套:前端负责感知与快速响应,云端负责深度理解与模型演进,两者通过安全、高效的通道互动。用得惯就把SDK接上,慢慢调词库、开缓存,体验就会越来越顺手。